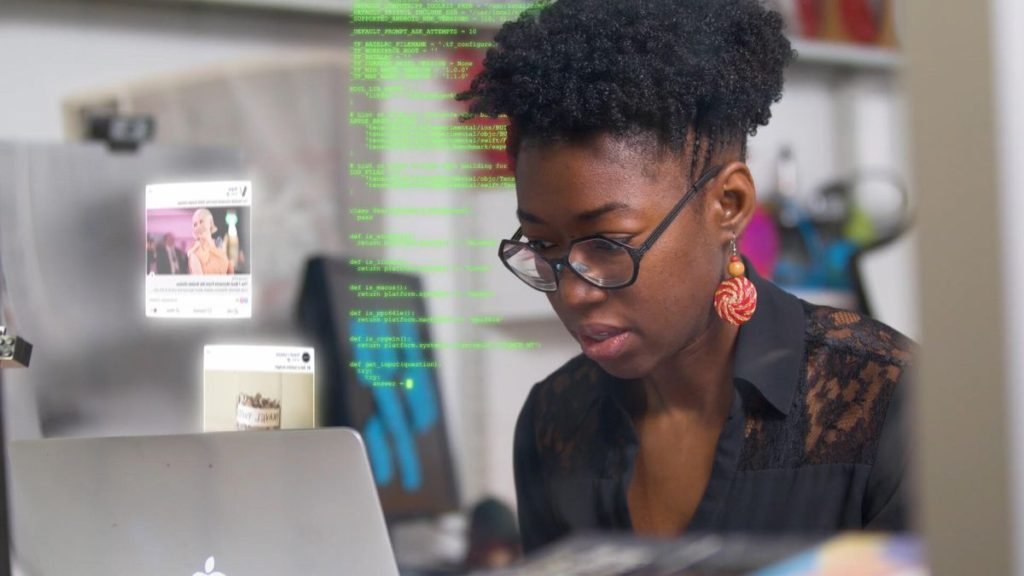

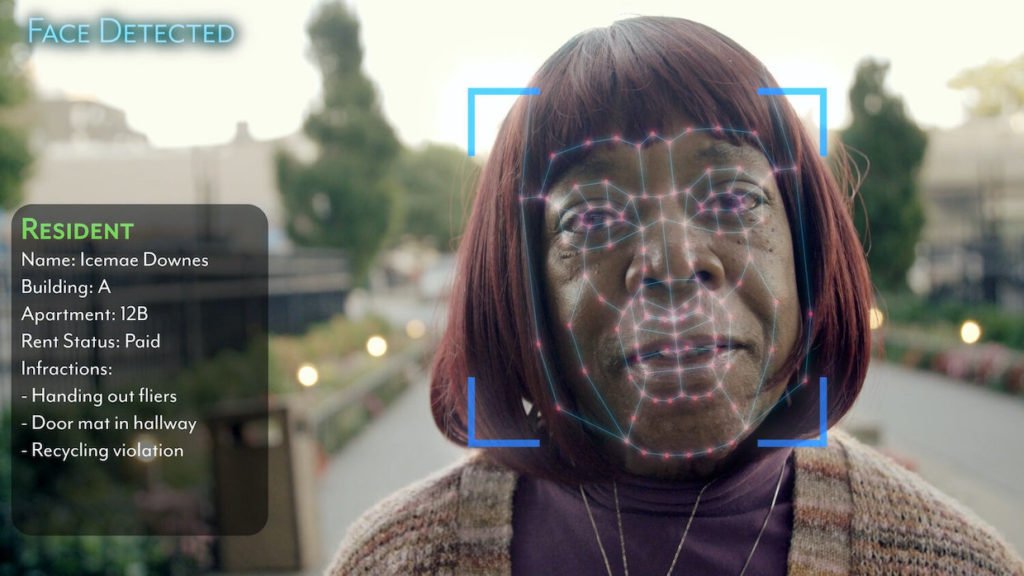

Coded Bias, documentário na Netflix, investiga o viés nos algoritmos depois que a pesquisadora Joy Buolamwini, do MIT, descobriu falhas na tecnologia de reconhecimento facial.

O enredo começa com a descoberta de Joy Budamwini da discriminação de gênero contida num sistema de reconhecimento facial que seria usado num projeto de arte e tecnologia: o sistema só reagia quando Budamwini, que é negra, colocava uma máscara branca.

Impactada pela descoberta e motivada pelo livro de Kathy O’Neal (Weapons of Math Destrucution: How big data increases inequality and threatens democracy, 2016), Budamwini empreendeu uma longa batalha contra o uso indiscriminado dessa tecnologia, substanciada em investigações científicas e análise de casos reais. Em maio de 2019, provocada por ela e seus colaboradores, ocorreu a Primeira Audiência no Congresso Americano sobre o uso de tecnologias de reconhecimento facial.

Aprendizado de Máquina – Machine Learning

A questão dos algoritmos utilizados na coletas de dados e reconhecimento facial é bem abordado pelo professor Ângelo do canal Cérebro Eletrônico IFSP, no episódio 17 – Questões Éticas em IA – algoritmos tendenciosos (Coded Bias).

Para abordar questões de ética na área de machine learning, o vídeo discute tópicos apresentados no filme “Coded Bias” da Netflix, tais como, o viés existente na base de dados de sistemas de IA que já estão em uso comercial.